Adobe hat mit Firefly eine Reihe generativer KI-Modelle vorgestellt, die sich zunächst auf die Erstellung von Bildern und Texteffekten konzentrieren und sich direkt in die Workflows der Creative Cloud, Document Cloud, Experience Cloud und Adobe Express einfügen, in denen Inhalte erstellt und verändert werden. Firefly ist Teil einer Reihe neuer generativer KI-Dienste von Adobe Sensei, die in allen Clouds von Adobe angeboten werden.

Adobe blickt mittlerweile auf eine über zehnjährige Geschichte von KI-Innovation zurück und hat mit Adobe Sensei Hunderte von smarten Funktionen in Anwendungen integriert. Tools wie Neural Filter in Photoshop, Content Aware Fill in After Effects, Attribution AI in Adobe Experience Platform und Liquid Mode in Acrobat ermöglichen es, Inhalte zu erstellen, zu bearbeiten, zu messen, sie zu optimieren und zu überprüfen. Diese Technologien werden im Einklang mit Adobes KI-Ethik-Prinzipien der Rechenschaftspflicht, Verantwortung und Transparenz entwickelt und eingesetzt. „Generative KI ist die nächste Evolutionsstufe der KI-gesteuerten Kreativität und Produktivität, die die Konversation zwischen Creator und Computer natürlicher, intuitiver und leistungsfähiger macht“, so David Wadhwani, President Digital Media Business, Adobe. „Mit Firefly bringt Adobe generative KI-gestützte ‚kreative Zutaten‘ direkt in die Arbeitsabläufe der Anwender und steigert so die Produktivität und das kreative Selbstvertrauen vom High-End-Kreativen bis hin zum ‚Long Tail‘ der Kreativwirtschaft.“

Beta Version

Adobe entwickelt Firefly, um Kreativen neue Designmöglichkeiten zu eröffnen. Mit Firefly kann jeder unabhängig von Erfahrung oder Talent Worte in Bildern, Audio, Vektoren, Videos und 3D bis zu Pinseln, Farbverläufen und Videotransformationen verwandeln, und das schneller und leichter denn je. Mit Firefly wird es möglich sein, unbegrenzte Content-Variationen zu erstellen und immer wieder Änderungen vorzunehmen – und das alles konsistent zur eigenen Marke. Adobe wird Firefly direkt in seine Tools und Dienste integrieren, sodass Anwender generative KI in bestehende Arbeitsabläufe einbinden können.

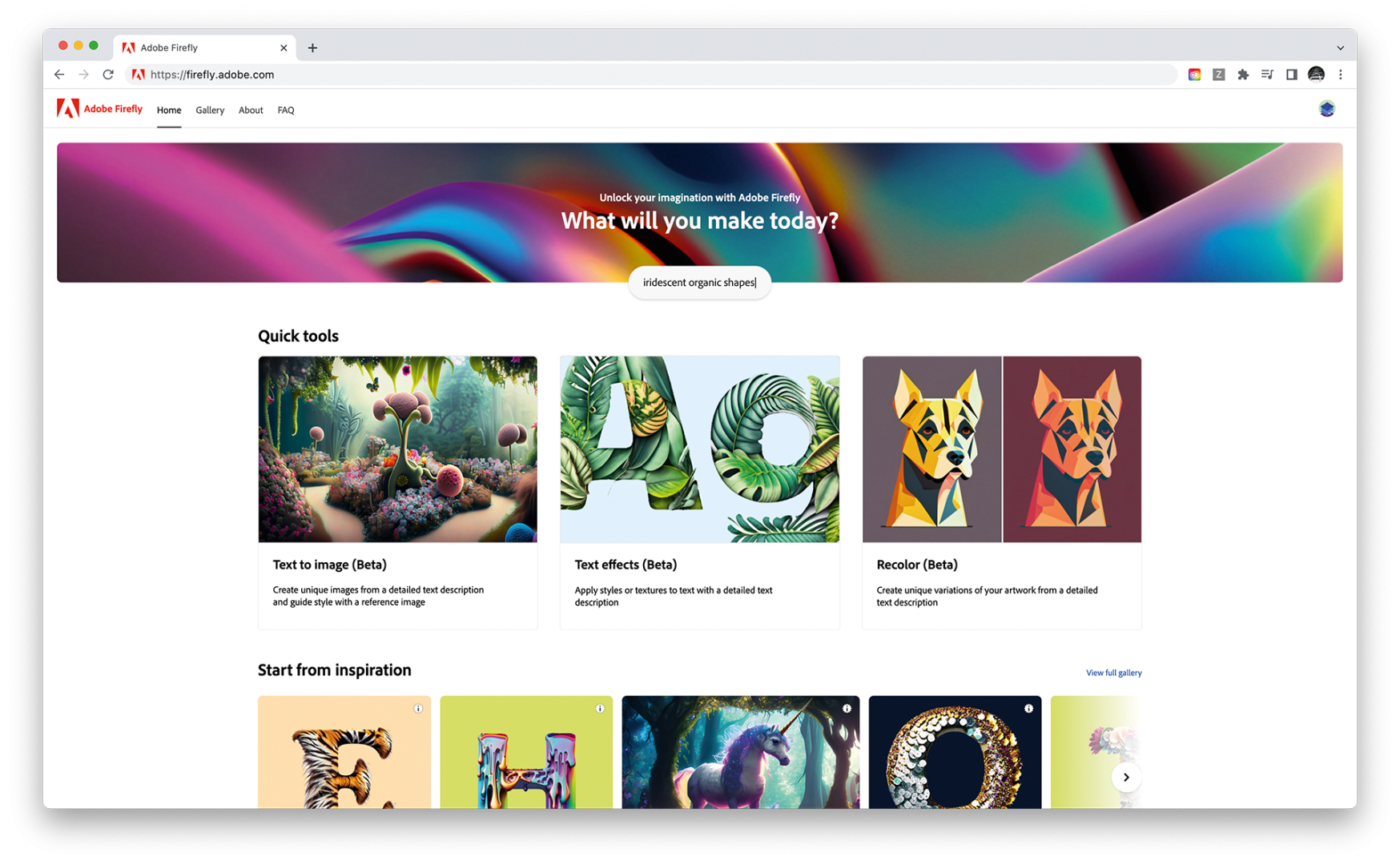

Adobe hat eine Beta-Version von Firefly veröffentlicht, die zeigt, wie Bilder und Texteffekte erzeugt werden können. Im Rahmen des Betaprozesses will das Unternehmen mit der Kreativ-Community zusammenarbeiten, um die Technologie weiterzuentwickeln und in die Arbeitsabläufe seiner Anwendungen zu integrieren. Die ersten Applikationen mit Firefly-Integration sind Adobe Express, Adobe Experience Manager, Adobe Photoshop und Adobe Illustrator.

Do Not Train

Adobes erstes Modell, das mit Adobe Stock-Bildern, offen lizenzierten Inhalten und Public Domain-Inhalten, deren Copyright abgelaufen ist, trainiert wird, konzentriert sich auf Bilder und Texteffekte. Hier werden nur Inhalte generiert, die für die kommerzielle Nutzung sicher sind. Die 100 Millionen lizenzierten Bilder von Adobe Stock bewirken, dass Firefly keine Inhalte generiert, die auf dazu nicht lizensiertem geistigen Eigentum basieren. Zukünftige Firefly-Modelle sollen eine Vielzahl von Assets, Technologien und Trainingsdaten von Adobe und anderen Unternehmen nutzen.

Adobe plant, seine generativen KI-Dienste so zu gestalten, dass Anwender ihre Talente zu Geld machen können. Ähnlich wie bei Adobe Stock und Behance sollen neue Verdienstmöglichkeiten für Adobe Stock-Designer eingeführt werden. Sobald die Beta-Phase beendet ist, werden Details zur Entlohnung bekannt gegeben.

Adobe hat die Content Authenticity Initiative (CAI) gegründet, um einen globalen Standard für die vertrauenswürdige Zuordnung von digitalen Inhalten zu schaffen. Mit mehr als 900 Mitgliedern weltweit war die Rolle der CAI noch nie so wichtig wie heute. Adobe setzt sich für offene Industriestandards ein und nutzt dazu die kostenlosen Open-Source-Tools der CAI, die von der gemeinnützigen Coalition for Content Provenance and Authenticity (C2PA) aktiv weiterentwickelt werden. Zu diesen Zielen gehört ein universelles „Do Not Train“ Content Credentials-Tag in den Content Credentials des Bildes. So können Ersteller verlangen, dass ihre Inhalte nicht zum Trainieren von Modellen verwendet werden dürfen. Die Markierung bleibt mit dem Inhalt verknüpft, wo immer er verwendet, veröffentlicht oder gespeichert wird. Darüber hinaus werden KI-generierte Inhalte entsprechend gekennzeichnet.